Seedance 2 — большой шаг вперёд для ИИ-аниме

Новая видеомодель ByteDance меняет возможности создателей аниме

Seedance 2.0 Demo pic.twitter.com/example

— Esoteric Cofe (@EsotericCofe) February 2026

ByteDance только что выпустила Seedance 2, и это может быть самым большим скачком в генерации ИИ-видео для аниме. Предыдущие модели могли создавать впечатляющие клипы, но они испытывали трудности с тем, что действительно нужно создателям аниме: согласованные персонажи, контролируемая работа камеры и аудио, которое не кажется приклеенным. Seedance 2 решает все эти проблемы.

Почему предыдущие ИИ-видеомодели не справлялись с аниме

Генерация ИИ-видео быстро улучшалась, но аниме всегда было особенно требовательным направлением. Традиционное производство аниме опирается на экстремальную согласованность: лицо, волосы и одежда персонажа должны выглядеть идентично на сотнях кадров. Углы камеры следуют намеренной кинематографической грамматике. Озвучка и звуковой дизайн тесно синхронизированы.

Большинство ИИ-видеомоделей рассматривают каждую генерацию как изолированное событие. Вы вводите промпт — получаете клип. Но если вы генерируете два клипа с одним и тем же персонажем, у них могут быть разные цвета глаз, разная длина волос или совершенно другое лицо. Это неприемлемо для любого вида повествования.

Качество движения тоже было проблемой. ИИ-сгенерированные аниме-персонажи обычно двигаются плавающим, неестественным образом, с конечностями, которые растягиваются и искажаются посреди клипа. Для медиа, где движение — это всё, это критически важно.

Что предлагает Seedance 2

Seedance 2 построена на архитектуре Dual-Branch Diffusion Transformer, которая генерирует видео и аудио за один проход. Это значимое техническое отличие: вместо того чтобы сначала генерировать видео, а затем пытаться подогнать к нему аудио, оба создаются вместе, что обеспечивает гораздо более точную синхронизацию.

Вот что выделяется для аниме-применений:

Согласованность персонажей между кадрами

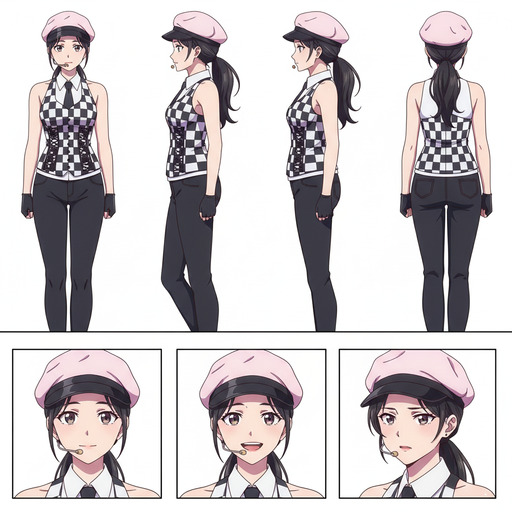

Seedance 2 принимает до 12 референсных файлов, включая 9 изображений, 3 видео и 3 аудиофайла, в качестве входных данных вместе с текстовыми промптами. Для создателей аниме это означает, что вы можете загружать референсные листы персонажей, конкретные позы и стилевые гайды для поддержания визуальной идентичности при множественных генерациях. Модель сохраняет черты лица, детали одежды и пропорции так, как предыдущие модели просто не могли.

Кинематографический контроль камеры

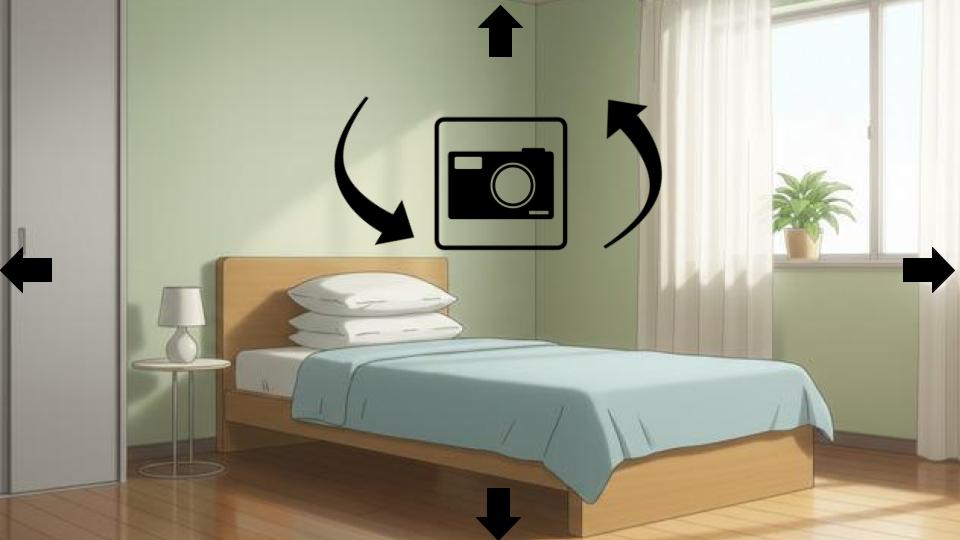

Аниме сильно зависит от языка камеры: драматические наезды, медленные панорамы по окружению, следящие съёмки во время экшн-сцен. Seedance 2 вводит синтаксис @mention, который даёт создателям точный контроль над движениями камеры и переходами. Вы можете задавать сложные многокадровые последовательности с автоматическими переходами камеры — то, что было практически невозможно с более ранними моделями.

Нативная синхронизация губ и аудио

Одна из главных функций Seedance 2 — синхронизация губ на уровне фонем на 8+ языках. Для аниме, где сцены с диалогами занимают центральное место, это трансформационно. Раньше рабочие процессы требовали генерации видео, а затем ручной синхронизации аудио, часто с плохими результатами. Seedance 2 создаёт управляемые аудио движения лицевых мышц, приближающиеся к профессиональному качеству захвата движения.

До 2K разрешения

Модель выводит нативно 1080p с апскейлингом до 2K, что соответствует разрешению современных аниме-продакшнов. Более ранние ИИ-видеомодели часто ограничивались более низкими разрешениями или создавали видимые артефакты при увеличении.

Что это значит для создателей аниме

Разрыв между «ИИ-сгенерированным видеоклипом» и «пригодным для использования аниме-материалом» постоянно сокращался, но Seedance 2 значительно его уменьшает. Согласованность персонажей означает, что вы действительно можете строить нарративы. Контроль камеры означает, что вы можете компоновать кадры с намерением. Синхронизация аудио означает, что диалоговые сцены не требуют мучительных обходных путей в пост-продакшне.

Ничто из этого не означает, что Seedance 2 заменяет традиционное производство аниме. Это не так. Но для инди-создателей, любителей и небольших студий, экспериментирующих с ИИ-ассистированными рабочими процессами, открываются возможности, которые были нереальны ещё несколько месяцев назад.

Модель также отлично справляется с переносом стиля. Загрузите аниме-референсные изображения, и она сможет убедительно генерировать видео, соответствующее эстетике, будь то тёплый стиль Ghibli, киберпанк-эдж или чистый slice-of-life вид.

Сравнение с другими моделями

Seedance 2 — не единственная доступная ИИ-видеомодель, но в настоящее время она лидирует по управляемости и согласованности — двум вещам, которые наиболее важны для производства аниме. Модели типа Sora 2 могут создавать более фотореалистичные физические симуляции, но когда дело касается стилизованного контента с постоянными персонажами, Seedance 2 имеет преимущество.

Улучшение скорости на 30% по сравнению с предшественником тоже практически важно. Более быстрая генерация означает больше итераций, а значит — лучшие результаты.

Что дальше

Мы активно работаем над интеграцией Seedance 2 в AutoWeeb. Наша цель — объединить сырые возможности генерации видео Seedance 2 с инструментами AutoWeeb, специфичными для аниме: карточками персонажей, конструкторами сцен и системами стилей, созданными специально для аниме-рабочих процессов.

Если вас интересует ИИ-аниме-видео, это самое захватывающее развитие за последнее время. Следите за обновлениями.

Попробуйте AutoWeeb сейчас