Seedance 2:AI动漫的一大飞跃

字节跳动的新视频模型改变了动漫创作者的可能性

Seedance 2.0 Demo pic.twitter.com/example

— Esoteric Cofe (@EsotericCofe) February 2026

字节跳动刚刚发布了Seedance 2,这可能是我们在AI动漫视频生成领域见过的最大单次飞跃。之前的模型可以生成令人印象深刻的片段,但在动漫创作者真正需要的方面却力不从心:一致的角色、可控的镜头运动以及自然融合的音频。Seedance 2解决了所有这些问题。

为什么之前的AI视频模型不适合动漫

AI视频生成进步迅速,但动漫始终是一个特别苛刻的应用场景。传统动漫制作依赖极高的一致性:角色的面部、发型和服装必须在数百个镜头中看起来完全一样。镜头角度遵循严格的电影语法。配音和音效设计需要精密的同步。

大多数AI视频模型将每次生成视为独立事件。你输入一个提示词,得到一个片段。但如果你生成同一角色的两个片段,它们可能有不同的眼睛颜色、不同的头发长度,甚至完全不同的面孔。这对任何形式的叙事来说都是致命的。

动作质量也是一大痛点。AI生成的动漫角色往往以飘浮、不自然的方式运动,四肢在片段中途拉伸和变形。对于一个以动作为核心的媒介来说,这至关重要。

Seedance 2带来了什么

Seedance 2基于双分支扩散Transformer架构构建,在单次前向传播中同时生成视频和音频。这是一个有意义的技术区分:不是先生成视频再尝试匹配音频,而是两者同时产生,从而实现更紧密的同步。

以下是对动漫应用场景最突出的特点:

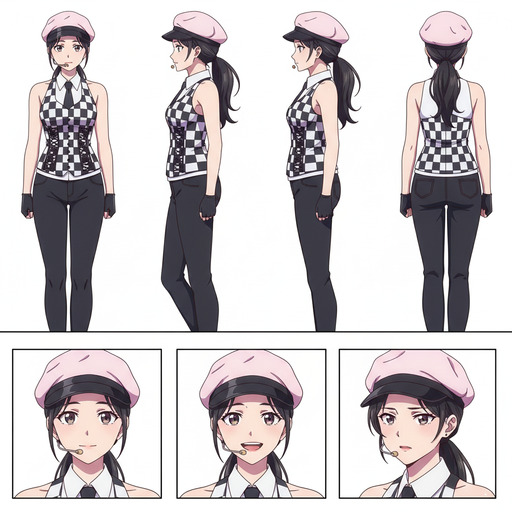

跨镜头角色一致性

Seedance 2接受最多12个参考文件作为输入,包括9张图片、3个视频和3个音频文件,与文字提示词一起使用。对于动漫创作者来说,这意味着你可以输入角色参考图、特定姿势和风格指南,以在多次生成中保持视觉一致性。该模型在面部特征、服装细节和比例方面的保持能力远超之前的模型。

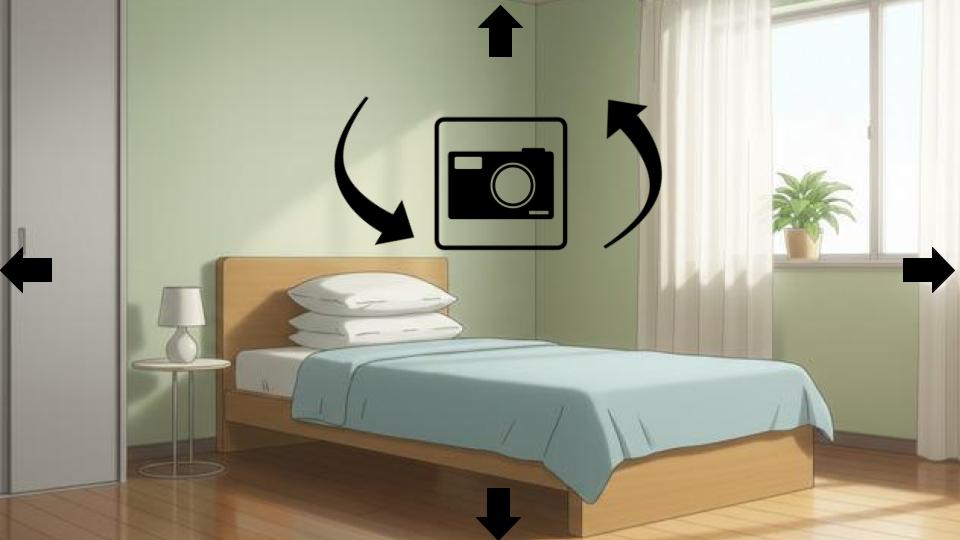

电影级镜头控制

动漫高度依赖镜头语言:戏剧性的推近、缓慢的环境平移、动作场景中的跟踪镜头。Seedance 2引入了@提及语法,让创作者对镜头运动和转场拥有精确控制。你可以指定复杂的多镜头序列并自动进行镜头转场,这在早期模型中基本上是不可能的。

原生口型同步和音频

Seedance 2的标志性功能之一是支持8种以上语言的音素级口型同步。对于以对话场景为核心的动漫来说,这是革命性的。之前的工作流程需要先生成视频,然后手动同步音频,效果往往不理想。Seedance 2生成的音频驱动面部肌肉运动接近专业动作捕捉的质量。

最高2K分辨率

该模型原生输出最高1080p,并支持2K上采样,与现代动漫制作的分辨率标准一致。早期的AI视频模型通常只能达到较低的分辨率,或在上采样时出现明显的伪影。

这对动漫创作者意味着什么

"AI生成视频片段"与"可用动漫素材"之间的差距一直在稳步缩小,而Seedance 2大幅缩小了这一差距。角色一致性意味着你真的可以构建叙事。镜头控制意味着你可以有意识地构图。音频同步意味着对话场景不再需要痛苦的后期制作。

这并不意味着Seedance 2能替代传统动漫制作。它不能。但对于独立创作者、爱好者和尝试AI辅助工作流程的小型工作室来说,它打开了几个月前还不现实的可能性。

该模型在风格迁移方面也表现出色。输入动漫参考图片后,它可以生成令人信服地匹配该美学风格的视频,无论你追求的是吉卜力的温暖感、赛博朋克的锐利感,还是干净的日常生活动漫风格。

与其他模型的对比

Seedance 2并不是唯一的AI视频模型,但它目前在可控性和一致性方面领先——这两点对动漫制作最为重要。像Sora 2这样的模型可能在写实物理模拟方面更出色,但在角色持续出现的风格化内容方面,Seedance 2更具优势。

相比前代产品30%的速度提升也很有实际意义。更快的生成意味着更多迭代,也就意味着更好的结果。

下一步

我们正在积极将Seedance 2集成到AutoWeeb中。我们的目标是将Seedance 2的原始视频生成能力与AutoWeeb的动漫专用工具相结合:角色设定图、场景构建器和专为动漫工作流程打造的风格系统。

如果你对AI动漫视频感兴趣,这是近期最令人兴奋的进展。敬请关注。

立即试用AutoWeeb